HCL Unica Suite での比較分析

2020/12/5 - 読み終える時間: 7 分

Comparative analysis in Unica Suite の翻訳版です。

HCL Unica Suite での比較分析

2020年12月2日

著者: Nitin Dhabale / Product Support Lead, Unica

どのメールのデザインが最もよく機能するか、またはどこでターゲットユーザーからのより多くの関心を測定するためにオファーのバナーを追加する必要がありますか? 異なるバージョンのマーケティングオファーやメーリング、または異なるセグメントの成功と受容を比較分析することは、今日のマーケティングの本質です。

人気のある格言である「比較は喜びの泥棒」は、異なるマーケティング戦略によって結果を比較することになると良いことはありません。この場合、比較は必ずしも悪いことではありません。マーケティングオファー、マーケティングメール、Web サイト、ソーシャルメディアの投稿など、異なる変数を比較することで、どれが最もパフォーマンスが高いのかを明らかにすることができます。このような比較・分析は、スプリットテストとも呼ばれる A/B テストで行うのが最適です。

HCL Unica Suite は、インバウンドとアウトバウンドの異なる製品の比較分析を行うことができます。

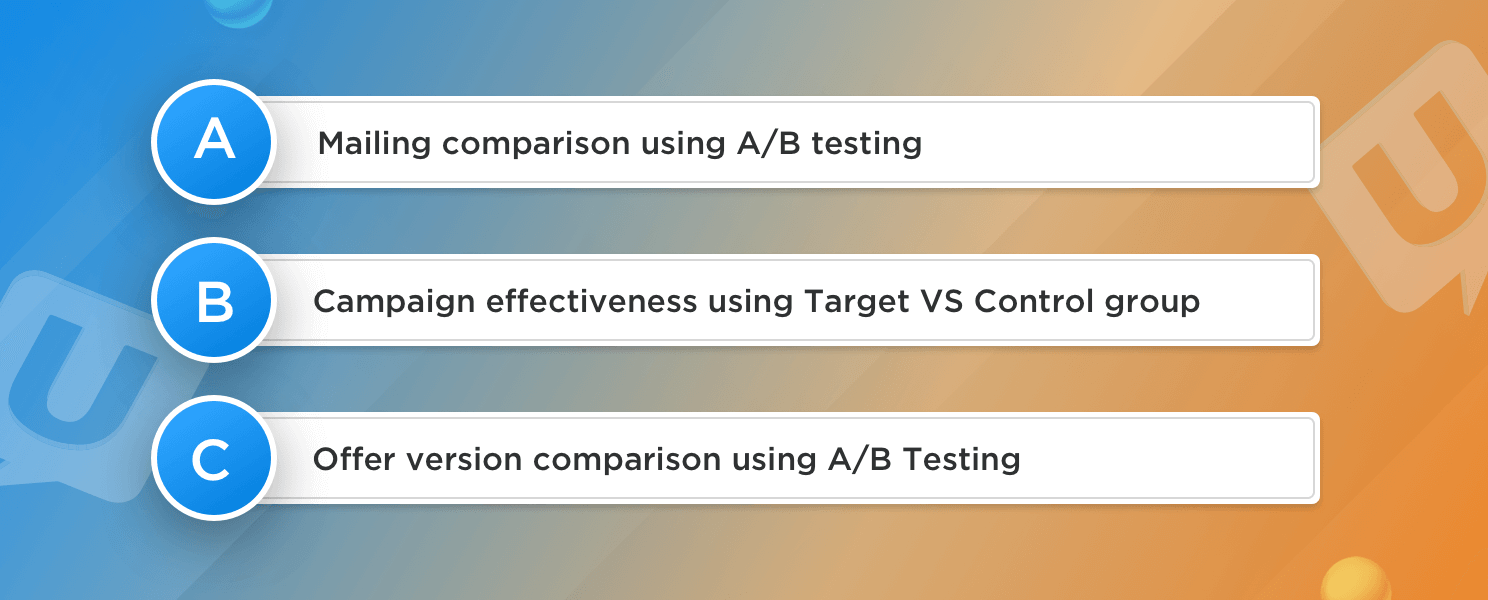

- A/B テストを用いたメールの比較

Unica Deliverで最も効果的なメールデザイン/メッセージ内容/メール件名を知るには

- ターゲット vs コントロールグループを用いたキャンペーン効果

対象グループとコントロールグループの回答を比較して、Unica Campaign の成功と効果を確認する。

- A/B テストを利用したオファーバージョンの比較

Interact で最も効果的なオファーやオファーバージョンを調べること。

この記事では、上記の3つの方法をそれぞれ詳しく見ていき、比較分析にどのように活用しているのかを見ていきます。

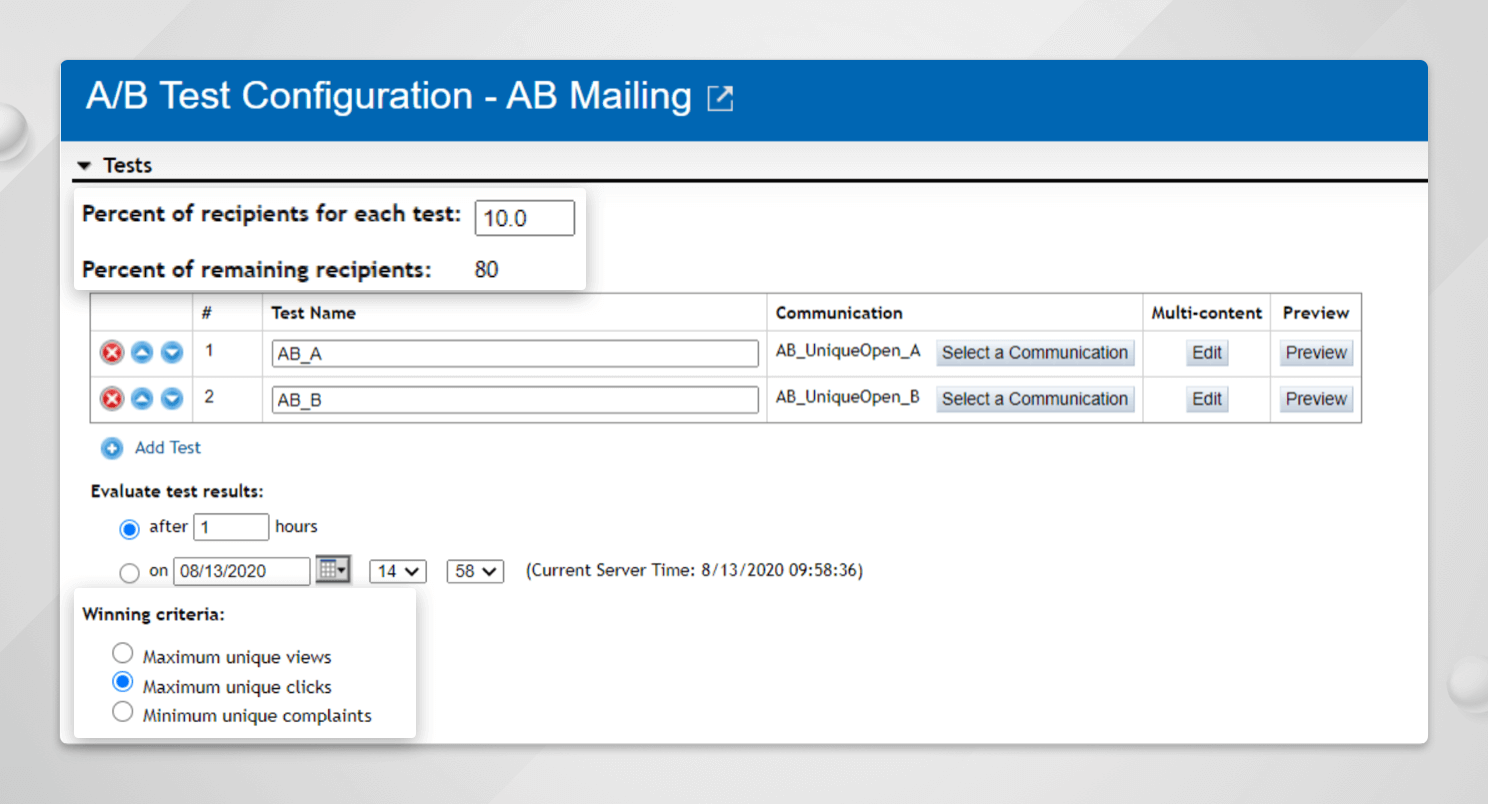

A/B テストを使用したメールの比較

はじめに

Unica Deliver では、ユーザーがA/B テストを設定・実施し、最も効果的なバージョン(勝者) の HTML メールメッセージを自動的に受信者に送信することができます。A/B テストとしてメールを送信することで、受信者の反応を利用して、最も効果的なメールデザインやメッセージ内容を決定します。ユーザーが A/B テストとしてメールを送信すると、システムは、異なるメールメッセージ、または同じメッセージの異なるバージョンを、2~5 つのサンプルグループの受信者に送信します。

A/B テストでは、異なるメッセージのさまざまな組み合わせ、レイアウト、コンテンツのバリエーション、件名などに対して、受信者がどのように反応するかを比較することができます。

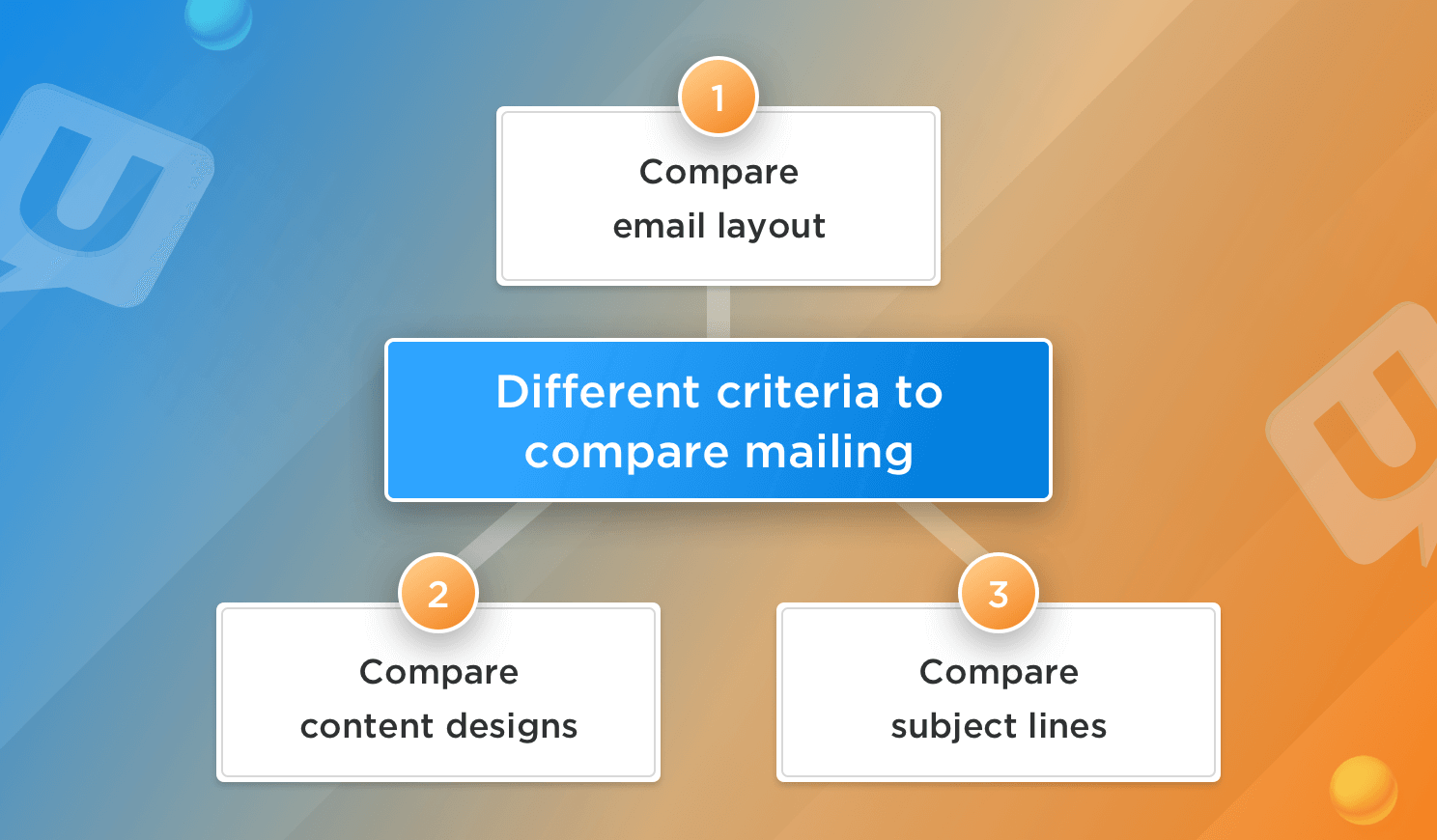

A/B テストでメーリングリストを比較するためのさまざまな基準。

ユーザーは以下の基準で結果を比較することができます。

- メールのレイアウトの違い。

- 同じメールレイアウト内で異なるコンテンツ要素(異なるレイアウトと異なるコンテンツの組み合わせ)

- 異なるメールの件名

A/B テストでメールのレイアウトを比較する

例えば、ユーザーが A/B テストを実施して、新規アカウント開設や特別オファーを受けるためのリンクを含むメールを送信するとします。

- メッセージの先頭に行動喚起を配置するメールコミュニケーションを1つ作成します。

- メッセージの下部にリンクを配置する別のコミュニケーションを作成します。

- A/B テスト構成にそれぞれのドキュメントを個別のテストとして追加し、より効果的なデザインを決定します。

メールレイアウトの異なるバージョンを比較するには、評価基準として「最大ユニーククリック数」を選択します。

A/B テストでコンテンツデザインを比較する

ユーザーは、メールメッセージのレイアウトの変更ではなく、コンテンツの変更の効果を判断したい場合があります。

例えば、以下のような場合です。

- メール通信では、メール通信のゾーンに複数のバージョンのサインアップボタンを追加します。A/B テストの設定では、ボタンの各バージョンを別のテストとして追加します。

- コールトゥアクションでグラフィックを使用した場合と人物写真を使用した場合の結果を比較する。

- 見出しやサインアップボタンの色やグラフィックを比較する。

- 見出しに「無料」という言葉を入れるとどうなるかを見てみましょう。

- さまざまな年齢層の人々を示す画像を比較する。

- 短いメッセージと長いメッセージを比較する。

- さまざまな書体を試してみる。

- 1 列レイアウトと複数列レイアウトを比較します。

評価基準として「最大ユニーククリック数」を選択します。

A/B テストで件名を比較します。

テストの目的は、どの件名のバリエーションが最も多くの受信者にメールを開かせるかを判断することです。

例

- ユーザーは、それぞれが異なる件名のメール文書を複数作成し、A/B テストでそれぞれの文書を別のテストスプリットに追加することができます。

- 代わりに、複数のメールの件名を含む 1 つのメール ドキュメントをドキュメント コンポーザーで作成することもできます。

件名の最も魅力的なバリエーションを比較するには、評価基準として 「最大ユニークビュー」を選択 するか、評価基準として 「最小ユニーククレーム」 を選択します。

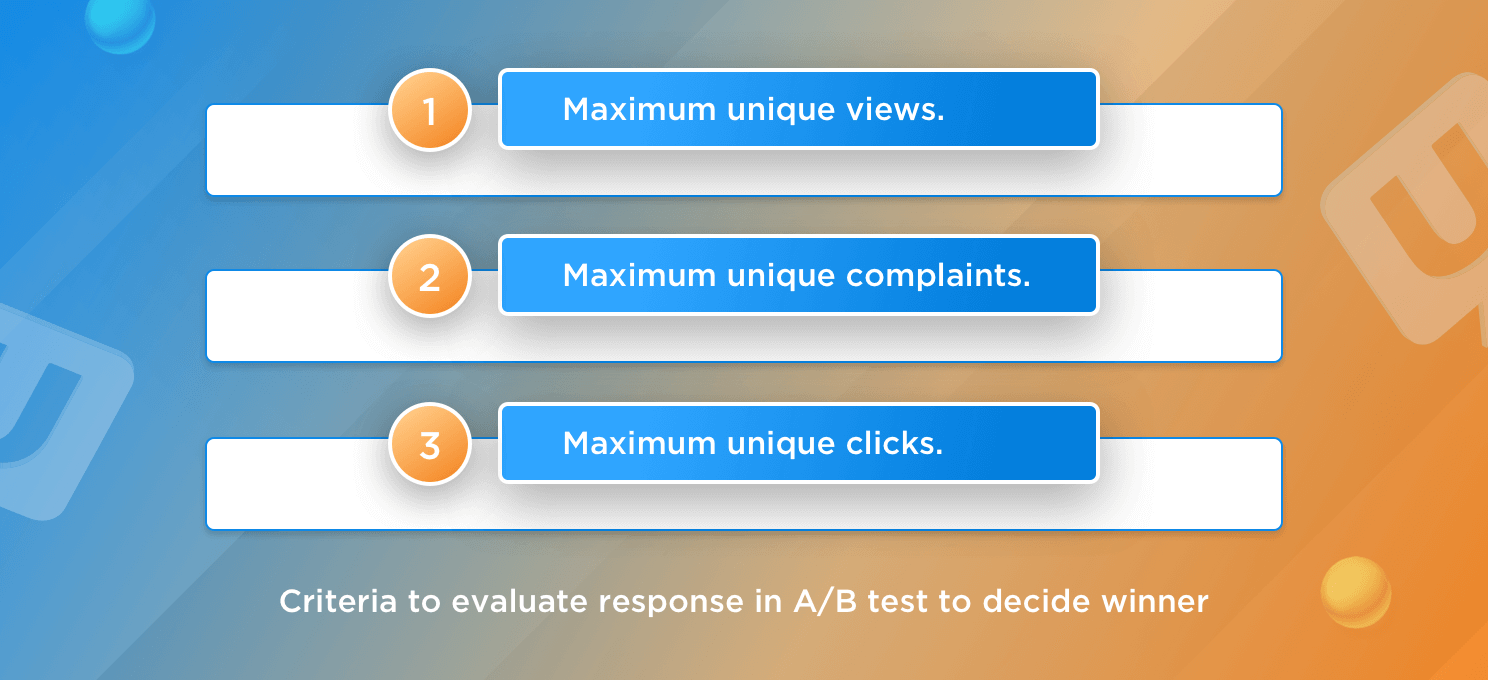

A/B テストでレスポンスを評価して勝敗を決めるための評価基準

A/B テストの計画の一環として、ユーザーは勝者を決定するためのシステムの基準を定義する必要があります。 A/B テストでは、回答を評価するための3つの基準が用意されています。

-

最大ユニークビュー数 メールを開いた受信者の数を考慮します。例えば、メールの件名を比較するためにA/B テストを実施している場合、評価基準として最大ユニークビューを指定することができます。 A/B テストでは、最大ユニークビューを取得したバリエーションが勝者となります。

-

最小ユニーク不満数 何人の異なる受信者がメールをスパムとして報告したり、配信停止を求めたりしたかを考慮します。システムは、配信停止要求や、受信者がメッセージを迷惑メールやスパムとしてマークした ISP の表示を記録したときに、苦情を記録します。例えば、ユーザーがメールの件名を比較している場合、最小一意の苦情を評価基準として使用することで、現在のメールを避けるための件名のバリエーションを特定するのに役立ちます。A/B テストでは、最小ユニーククレーム数を獲得したバリエーションが勝者となります。

-

最大ユニーククリック数 メール内の少なくとも1つのリンクを何人の異なる受信者がクリックしたかを考慮します。例えば、ユーザーは最大ユニーククリック数を評価基準として使用して、異なるメールデザインや配置に対する受信者の反応を比較することができます。A/B テストでは、最大ユニーククリック数を獲得したバリエーションが勝者となります。

ターゲットとコントロールグループの分析

はじめに

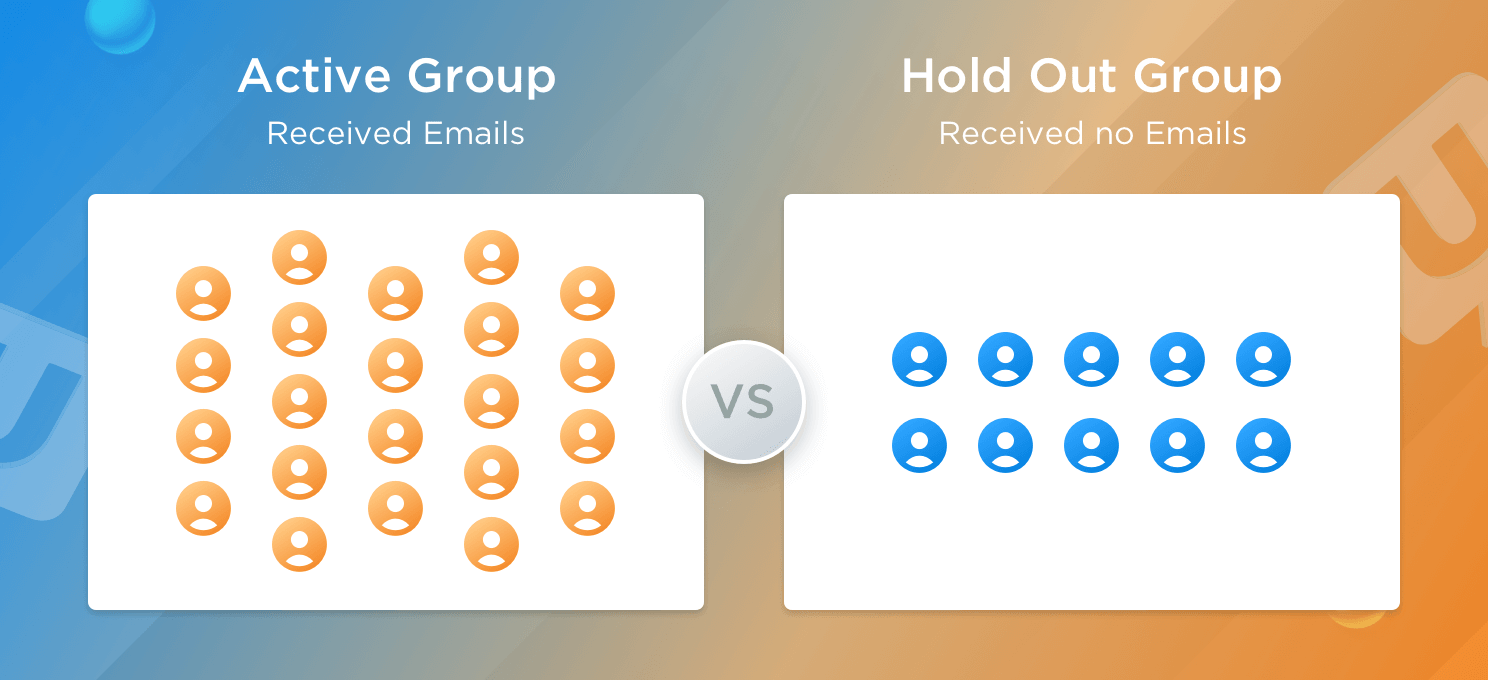

ターゲットグループとコントロールグループの反応を比較することは、マーケティングキャンペーンの効果を測定するための強力な分析ツールです。Unica Campaign では、分析目的でオファーの対象から意図的に除外したオーディエンス ID を含むグループをコントロールセルと呼びます。

ターゲットグループ/オファーの対象となるオーディエンス ID を含むセル。オーディエンスの一部は、オファーを受け取らないようにするために、マーケティングキャンペーンの異なるサンプリング手法に基づいて意図的に除外されます。キャンペーンが実行された後、マーケティング担当者は、コントロールグループとオファーを受け取ったグループの活動を比較し、キャンペーンの効果を判断します。

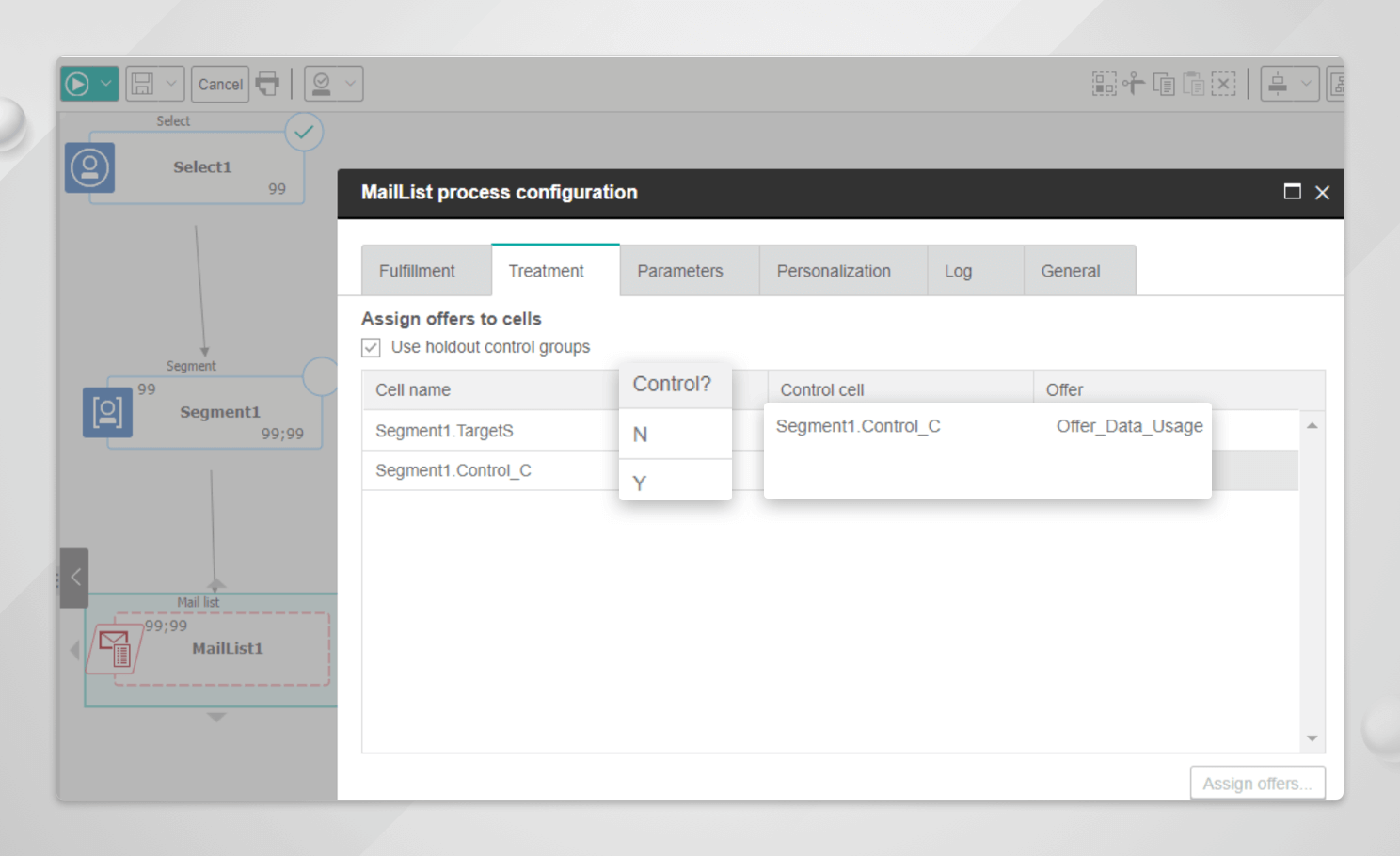

Unica でのターゲットとコントロールの比較

Unica Campaign では、ターゲットとコントロールは、ターゲットセルスプレッドシートまたはフローチャートの MailList / CallList プロセスボックスで定義できます。連絡先履歴テーブルは、ユーザーが本番モードでこれらのタイプのフローチャートを実行したときに入力されます。コンタクト履歴は、コントロールセルのメンバーと、保留された(コントロールに送信されなかった)オファーを識別します。

ターゲットグループのオーディエンスIDからのレスポンス vs コントロールセルのオーディエンス ID からのレスポンスを受信すると、Unica Campaign の ResponseHistory に入力されます。この履歴情報は、リフトや ROI の計算のために、ターゲットセルとコントロールセルからのレスポンスを分析・比較するのに役立ちます。

コントロールグループからの推測されるレスポンス

コントロールグループ(キャンペーンでは常にホールドアウトコントロール)のメンバーからのすべての回答は、推測される回答です。 コントロールグループのメンバーはコミュニケーションやオファーを受けていないため、トラッキングコードを返すことができないため、彼らの回答は興味のある属性にマッチしたものでトラッキングされます。

コントロールグループは常に複数の属性を使用してトラッキングされます。コントロールグループのメンバーからのすべての応答は、完全なクレジットを受け取ることができます。

Unica Campaign では、コントロールグループからの回答をターゲットグループに対する回答と比較するためのさまざまなレポートが用意されており、例えば、リフトオーバーコントロールグループ(コントロールグループと比較した回答の増加)などがあります。

分析とレポート

例 1

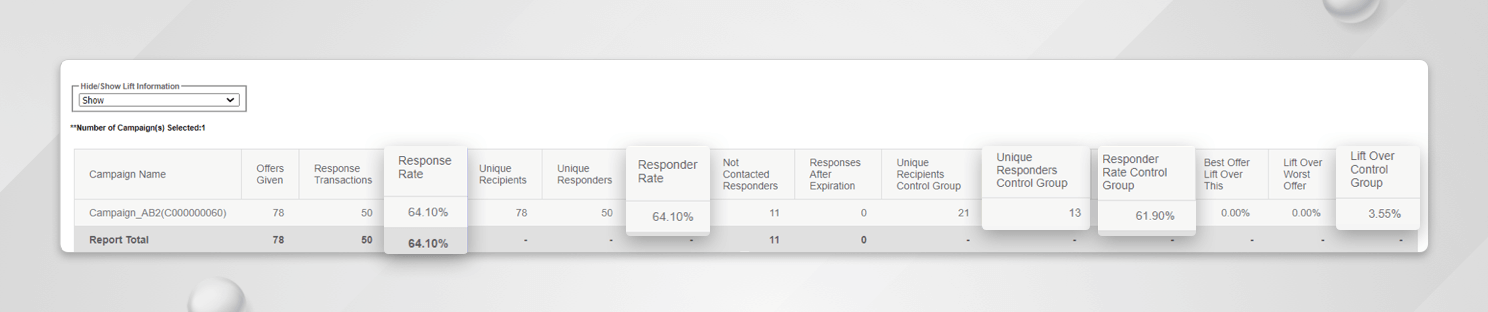

保険料の期限が 3 月 31 日である 98 人の契約者があると言います。会社は、保険料払込期日までに契約者に契約を更新してもらいたいと考えているので、78 名の契約者(ターゲットグループ)には 5%の割引を提供し、残りの 20 名の契約者(コントロールグループ)には 5%の割引を提供しません。これは、対象グループの回答率と、オファーをしないコントロールグループの回答率を確認して、5%割引オファーの効果を比較するためのものである。

オファーを受けた 78 名のうち、50 名がオファーに積極的に反応したとすると、反応率は 64.10%となり、オファーを行わなかった 20 名のうち 13 名が保険料を入金したとすると、反応率は 61.90%となります。このように、5%の割引を行っても、キャンペーンが効果的ではないと言われるほどの大きな違いや影響はありません。この場合、下の画像のようにリフトオーバーコントロールグループの価値は3.55%となります。

キャンペーン実績比較レポート

例2

キャンペーンでは、当座預金のオファーで口座をチェックする必要のない顧客グループをターゲットにすることがあります。コントロール・グループのメンバーは、当座預金のオファーと同じ期間内に当座預金を開設したかどうかを追跡されます。

リフトオーバーコントロールグループの値が高いほど、キャンペーンの効果が高いことを示しています。1つのコントロールグループを複数の対象グループのコントロールとして使用することができます。ただし、各ターゲットグループは1つのコントロールグループのみとすることができます。

A/B テストを利用したオファーまたはオファーバージョンの比較

Interact では、オファー版とオファー版の比較分析のために A/B テストを実施しました。これは、最も受け入れられやすいオファーバージョンをテストするために行われます。 すべてのプロパティが固定されている Interact の処理ルールでは、1つのパラメータだけが変化しますが、このパラメータは、オファーとオファーの属性の組み合わせです。

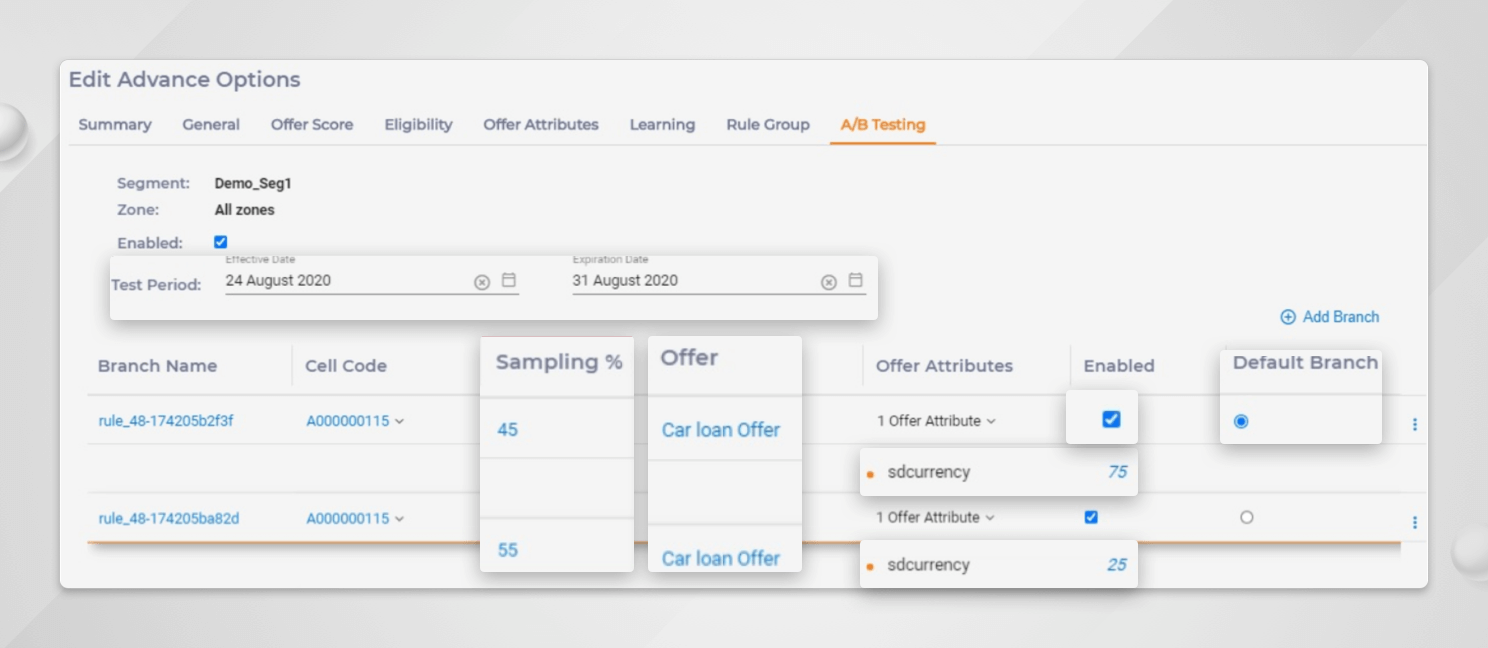

ルールの A/B テストでは、オファーおよび/またはオファー属性の各バリエーションは、指定されたオーディエンス分布を持つ1つのブランチを表します。

この A/B テストは、指定された有効期限と有効期限内でのみ有効です。有効期限がヌルの場合は、永久に有効です。

A/B テストを有効にするには、A/B テストタブの有効化チェックボックスをクリックします。これにより、基本ルールがブランチテーブルの最初のブランチとして追加されます。追加のブランチは、Add Branch をクリックすることで追加できます。

これが Base ブランチで、Comparative ブランチに関連しています。

A/B テストの結果を分析するために、キャンペーンデータベースの UACI_CHStaging と UACI_DtlContactHist テーブルに「ABTestBranch」という列をオプションで追加して、A/B テストが関連するスマートルールの調停に従事しているときに選択されたブランチの名前を記録することができます。

この列の情報は、他の処理フィールドと一緒に、ユーザーは個々のスマートルールの A/B テストブランチのパフォーマンスに関するレポートを作成することができます。

マーケティング効果と投資利益率を高めるためには、マーケターは異なる手法を用いて比較分析を行う必要があります。異なる HCL Unica 製品は、比較分析を行うために、A/B テスト、ターゲット対コントロール分析のような異なるテクニックを使用します。これは、接触疲労を回避し、より高い応答率、より多くの受け入れ、そしてより大きな顧客満足度を達成するのに役立ちます。Unicaでの動作を理解するための製品ガイドはこちらです。

その他のご質問がございましたら、お気軽にお問い合わせください。

Search

Categories

- Aftermarket Cloud (2)

- AppScan (184)

- BigFix (200)

- Cloud (14)

- Cloud サービス (1)

- Collaboration (625)

- Commerce (23)

- Customer Data Platform (1)

- Data Management (3)

- DevOps (223)

- Discover (2)

- Domino (1)

- General (237)

- News (11)

- Others (4)

- SX (2)

- Total Experience (14)

- Unica (172)

- Volt MX (75)

- Workload Automation (20)

- Z (48)